一、大數據概念:超越海量的多維價值

大數據并非單純指數據量的龐大,而是指在規模(Volume)、速度(Velocity)、多樣性(Variety)、價值(Value)和真實性(Veracity)這五個維度上超出傳統數據處理能力范圍的數據集合。其核心在于通過對海量、多源、實時或非結構化的數據進行采集、存儲、處理與分析,挖掘出新的知識、洞察和決策支持,驅動業務創新與效率提升。典型的大數據技術生態包括Hadoop、Spark、Flink等分布式計算框架,它們構成了處理大數據的基石。

二、大數據處理的核心挑戰:Shuffle及其調優

在大規模分布式計算(如Spark、MapReduce)中,Shuffle(洗牌)是連接不同計算階段的關鍵環節,指將數據按需重新分區和跨節點傳輸的過程。它是性能瓶頸的主要來源,不當的Shuffle會導致嚴重的磁盤I/O、網絡擁堵與內存壓力。

Shuffle調優的關鍵方向包括:

1. 減少數據量:在Map端通過combine(合并)或使用更高效的數據結構(如Bloom Filter)預先聚合,減少需要傳輸的數據。

2. 優化分區策略:避免數據傾斜,通過自定義Partitioner或使用salting(加鹽)技術,使數據在Reduce端均勻分布。

3. 調整緩沖區與壓縮:增大spark.shuffle.file.buffer(Spark)或mapreduce.task.io.sort.mb(Hadoop)等緩沖區大小,減少磁盤溢寫次數;啟用中間數據壓縮(如Snappy、LZ4)以降低網絡和磁盤I/O開銷。

4. 選擇高效的Shuffle機制:例如在Spark中,根據場景在sort、hash或tungsten-sort等Shuffle管理器間選擇。

三、系統級參數調優:釋放集群潛力

參數調優旨在根據數據特征、集群規模和硬件配置,精細化調整系統行為,以平衡資源利用、穩定性和性能。

重點調優領域:

1. 內存管理:合理設置Executor/Container的內存分配,劃分給堆內存、堆外內存(Off-Heap)以及Shuffle、緩存等特定用途的比例(如Spark的spark.memory.fraction)。避免頻繁的GC或OOM錯誤。

2. 并行度與資源分配:設置合適的任務并行度(如Spark的spark.default.parallelism),使其與集群核心數匹配,避免資源閑置或過度競爭。動態資源分配(如Spark Dynamic Allocation)可根據負載自動調整資源。

3. 容錯與穩定性:調整心跳超時、最大任務失敗次數等參數,提高作業在節點故障或網絡波動下的魯棒性。

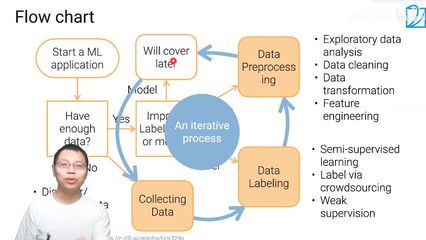

調優是一個迭代過程,需結合監控指標(GC時間、Shuffle讀寫量、任務執行時間分布等)持續分析與驗證。

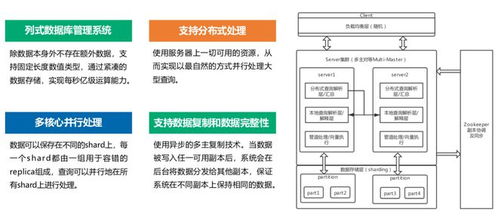

四、大數據儲存服務:持久化的基石

大數據儲存服務負責數據的可靠、高效、可擴展存儲,是上層計算與分析的前提。其演進從經典的分布式文件系統(如HDFS)擴展到對象存儲、NoSQL數據庫及云原生存儲服務。

主流儲存方案與考量:

1. HDFS:適合大文件、高吞吐的順序讀寫場景,為Hadoop生態的核心。調優關注塊大小、副本因子、機架感知及NameNode高可用。

2. 對象存儲(如S3、OSS、OBS):具有無限擴展性、高耐用性和低成本,常用于數據湖架構。需注意其最終一致性模型及與計算引擎(如Spark)的集成性能(可能需緩存層加速)。

3. NoSQL數據庫(如HBase、Cassandra):提供低延遲的隨機讀寫,適用于實時查詢。需根據訪問模式設計行鍵、列族等。

4. 云原生與湖倉一體:如Delta Lake、Iceberg等表格格式,在對象存儲之上提供ACID事務、模式演進等能力,構建統一的數據管理平臺。

儲存服務的選擇需綜合考量數據訪問模式(批處理/實時)、成本、一致性要求及與計算框架的集成度。

五、

大數據處理是一個系統工程。深入理解其核心概念是基礎,而性能優化則需聚焦于Shuffle這一關鍵路徑,并結合系統級參數進行精細調控。選擇與場景匹配的儲存服務,為數據全生命周期提供穩固高效的支撐。唯有將計算、存儲與資源管理協同優化,才能充分發揮大數據技術的價值,應對日益復雜的業務挑戰。